gregor hat geschrieben: ...Ich erinnere mich dabei immer an ein Interface, mit dem ich in den 90ern Ereignismessungen im Milisekundenbereich durchführen sollte. Mein Rechner hatte seinerzeit einen 80286 mit 10 Mhz und die Ansteuerung des Interface war in TurboPascal geschrieben. Anfangs waren die Messungen meist unbrauchbar. Erst als ich die Steuerroutinen des Herstellers komplett in Assembler neu geschrieben hatte, konnte ich die Performance der Hardware voll nutzen, der Hersteller hatte sämtliche Warteschleifen in sog. "while-Schleifen" geschrieben; meine Assemblerroutinen taten rein logisch das gleiche, nur eben viel schneller.

Dadurch konnte ich die Zeitfehler bei der Ansteuerung und auch beim Auslesen des Interface ganz erheblich reduzieren und folglich meine Messgenauigkeit deutlich steigern. Ein Herabsetzen der Buffergrößen erhöhte die Messgenauigkeit weiter.

... das glaube ich gern, der Rechner wurde an der Grenze betrieben und ein schnelleres Programm, niedrigere Puffergrößen erhöht Messgenauigkeiten, Abtastraten usw.

Aber bei Audio haben wir nur mal simple 44,1 kHz odermax. 192 kHz.

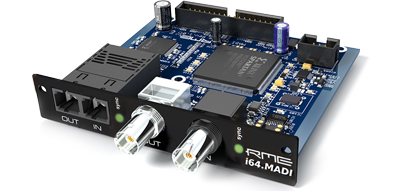

Wenn ich meinen HTPC mit 20% oder mit 60% Last betreibe (z.B. Datendownload), ich höre da keinen Unterschied. (Quad 2 MHz, JRiver, RME FF, FIR Faltung...). Erst wenn die Auslastung über 80% geht gibt es Knackser.

Nur mal als Beispiel:

Um einen Puffer in der DA-Wandlung abzuarbeiten braucht es (nur mal so als Beispiel) 100 ms, das ist durch den Takt bestimmt. Wenn ich es in diesen 100 ms nicht schaffe den Puffer mit einem neuen Paket zu befüllen kommt es zu Aussetzern.

Wenn der Puffer nach 50 ms befüllt ist, ist es also ok.

Durch Priorisierung, Abschaltung von Diensten usw. kann ich den Puffer vielleicht schon nach 10 ms befüllt haben, aber was soll das für einen Vorteil haben? Kann mir jemand erklären, warum es klangliche Vorteile haben soll, wenn der PC 90 ms wartet, bis er wieder rechnen darf? Die Rechenergebnisse bzw. Bits sind ja immer die gleichen.

Eine gleichmäßige Befüllungszeit werde ich nie erreichen, ein PC arbeitet nun mal diskontinuierlich, aber das ist ja auch überhaupt nicht nötig.

Für den USB-Bus gilt das Gleiche, wenn der überlastet ist, gibt es Aussetzer. Dann sollte man andere Geräte von diesem Bus nehmen.

Wenn ein Datenpaket nicht rechtzeitig da ist, gibt es drop outs. Verschlechterung einer Bühne, "Musikalität" etc. kann damit nicht zusammenhängen, denn dazu müssten die Zahlenwerte geändert werden.

Sorry, aber ich kann das weder hören noch nachvollziehen oder verstehen...

bin aber für überzeugende Argumente offen.

Es versteht sich natürlich, dass der DAC entkoppelt sein soll, d.h. kein HF-Müll einstreuen darf und die Spannungsversorgung unabhängig sein muss. Aber das setze ich voraus für einen guten DAC.